Antes era fácil detectar una sátira política en televisión o Internet porque por lo general era un doble quien actúaba y era claramente discernible de que se trataba de una imitación, también porque aparecía en programas de humor como Sábados Felices; pero eso ha cambiado. El reto para reconocer una imitación es más dificil y todo gracias a los deepfakes.

Si antes no confíabamos en los noticieros debido a las «fake news», ha llegado el momento perfecto para desconfiar de cualquier tipo de información debido a la proliferación de material audiovisual falso. Manipular a gran escala la percepción de la gente nunca fue tan fácil. El ojo humano no puede reconocer lo real de lo falso. Parece un gran viaje facilitado por el yagé.

La realidad es que ahora cualquier ciudadano puede crear deepfakes con la ayuda de un smartphone y acceso a una aplicación como Wombo. La app se ha hecho viral ya que puedes poner el rostro de cualquier persona en escenas de películas o series. Unos la usan por diversión mientras que otros pueden tener metas más oscuras.

Los deepfakes son tan peligrosos como las teorías conspirativas

Uno de los usos principales que le dan a esta tecnología y que he presenciado en Internet es el de crear vídeos falsos pero creíbles de individuos que representan o dicen algo que en realidad nunca dijeron. No hay que pensar mucho para determinar que cuando la «tecnología deepfake» cae en malas manos, se convierte en una fuente de desinformación, división, fraude y extorsión.

No es un secreto que la manipulación de imágenes para alterar la percepción pública por razones políticas se remonta al menos hasta Stalin, quien famosamente borró a sus «camaradas traidores» de las fotos oficiales que se imprimían. ¿Puede haber pasado en el Renacimiento? La respuesta la dejo a la curiosidad de quienes buscan en Google.

Aunque se piensa que esto sería un problema netamente de las élites políticas, yo creo que esta tecnología puede afectar el ámbito privado: familiares peleando por una herencia, usando deepfakes del difunto como prueba de su última voluntad; falsas acusaciones de violación; vídeos de seguridad alterados, pruebas falsas, etc. ¿Están los jueces preparados?

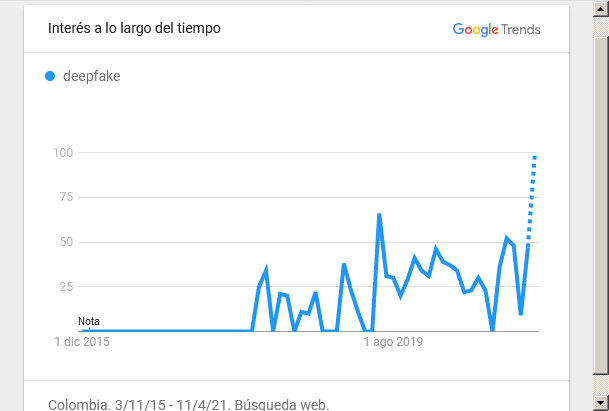

El interés por los deepfakes

Una breve búsqueda en Google Trends nos muestra que el interés por los deepfakes en Colombia ha aumentado en los últimos años. Santander se encuentra en la tercera posición entre los departamentos que más se interesan por el término.

¿Tal vez estamos exagerando ante los posibles peligros? Yo pienso que la tecnología en sí no es la mala del paseo, sino sus usos (como siempre). No se nos haga raro que en un futuro, los infractores de la ley se excusen argumentando «ese no soy yo, es un deepfake hecho por quienes me persiguen políticamente!«

Otro uso (que tiene que ver con los orígenes del término «deepfake«) y que podría ser beneficioso para ciertas personas, es el de ocultar el rostro verdadero. Solo imaginen a los webcammers que quieren blindar su identidad en línea al usar un rostro generado por inteligencia artificial, para de esta forma, evitar un futuro escarnio cuando se hayan retirado de sus oficios.

¿Regulación o prohibición?

Intentos por combatir los deepfakes desde el gobierno se han hecho notar, sobre todo en China donde es una crimen publicar deepfakes sin alguna advertencia o «disclosure». Acá en Colombia propusieron una ley para combatir fakenews, pero no pasa de ahí. Por lo general este tipo de proyectos tienen peligrosos artículos que amenazan la libertad de expresión, lo cual dificulta su sanción. Pero eso es otro tema.

¿Cómo detectar deepfakes en Colombia?

¿Hasta qué punto puede la gente corriente diferenciar un vídeo manipulado por la Inteligencia Artificial de un vídeo normal que no ha sido no alterado? ¿En quién confiaríamos para que nos dijera la verdad? ¿el Gobierno? Parece que es tarea de cada uno. Y por «cada uno» entiendo a los medios de comunicación, herramientas creadas por desarrolladores y en últimas, la familia misma.

Ya existen ciertas listas de chequeo para determinar si una noticia imagen o video es falso, pero seamos sinceros: no todos tendremos el tiempo para chequear. La única forma de que nos interese determinar la autenticidad de un audiovisual es cuando este nos afecte directamente en nuestra esfera privada.

8 pasos para detectar un deepfake

Pero sin ponernos muy técnicos, lo que me interesa es educar a las personas sin formación en este tipo de temas, a discernir un deepfake con una simple lista de chequeo. A continuación lo que se debe tener en cuenta si quieres reconocer un deepfake en Colombia:

- Preste atención a la cara. Las manipulaciones de alta gama de DeepFake son casi siempre transformaciones faciales.

- Preste atención a las mejillas y la frente. ¿La piel parece demasiado lisa o demasiado arrugada? ¿El envejecimiento de la piel es similar al del cabello y los ojos? Los DeepFakes suelen ser incongruentes en algunas dimensiones.

- Preste atención a los ojos y a las cejas. ¿Aparecen las sombras en los lugares que esperarías? Los DeepFakes no suelen representar completamente la física natural de una escena.

- Preste atención a las gafas. ¿Hay algún resplandor? ¿Hay demasiado resplandor? ¿Cambia el ángulo del resplandor cuando la persona se mueve? Una vez más, los DeepFakes no suelen representar completamente la física natural de la iluminación.

- Preste atención al vello facial o a su ausencia. ¿El vello facial parece real? Los DeepFakes pueden añadir o quitar un bigote, patillas o barba. Sin embargo, los DeepFakes a menudo no consiguen que las transformaciones del vello facial sean totalmente naturales.

- Preste atención a los lunares de la cara. ¿El lunar parece real?

- Preste atención al parpadeo. ¿Parpadea la persona lo suficiente o demasiado?

- Preste atención al tamaño y al color de los labios. ¿El tamaño y el color coinciden con el resto de la cara de la persona?

Estos ocho pasos pretenden orientar a las personas que quieran identificar deepfakes sin necesidad de usar software. Esta lista de preguntas sale directamente del MIT, quienes han ayudado a fomentar un reto entre empresas y académicos que busca identificar deepfakes de forma más fácil. Pueden leer más sobre el Deepfake Detection Challenge aquí.

Si te gustan las historias de ficción histórica, puedes leer esta sobre el asesinato del escritor caleño Andrés Caicedo.